无人直播场景中的语音技术:真实拟声的文本转语音技术实现

正文:

演示Demo https://www.bilibili.com/video/BV16G411v7vr?vd_source=f0b3774eb88ae2a53e22ed456f440c18

AI(人工智能)的进步和直播带货的兴起,语音技术在这个场景中的应用也日益需求增多。尤其是在无人直播带货中,语音技术的重要性更是突出。其中,音色替换和可预测感情文本转语音(TTS)是两种关键的语音技术,对于提升无人直播带货的体验和购买欲望具有重要作用。

流程包括文本预处理、声学模型处理训练和后处理三个步骤。首先,文本预处理会对标注的文本分析和处理,例如分词、词性标注和语法分析等。然后,声学模型训练会将文本转化为声学特征,这个过程通常需要大量的语音数据来训练。最后,后处理会对生成的语音波形进行优化和调整,以使其更符合直播带货的需求。

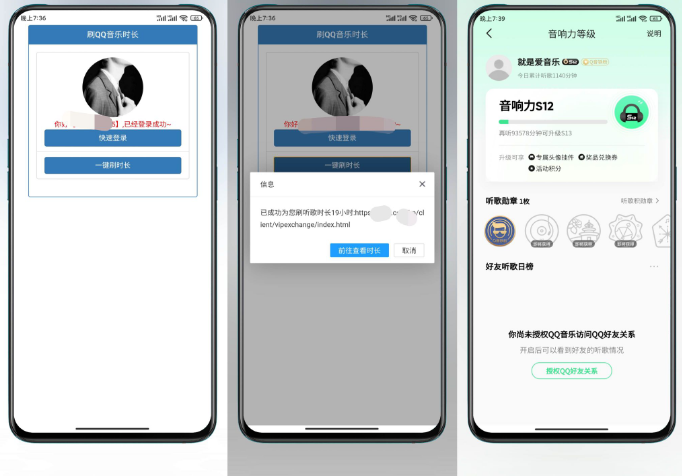

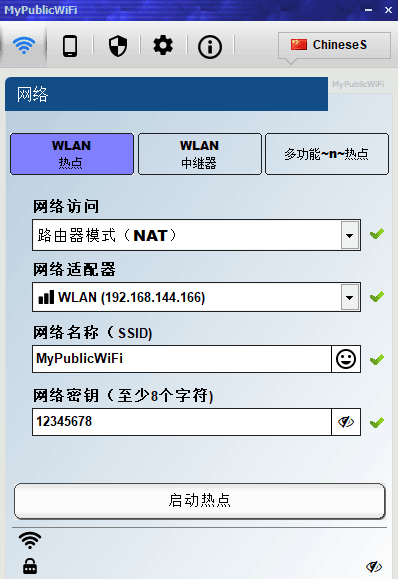

首先,我们需要准备所需的工具和整合包,包括各种软件和工具库。这些工具 我会在下方分享出来

音频切片+音频标注+模型训练首先,我们需要对训练声音素材进行提纯处理,去除掉背景音和杂音。这里推荐使用UVR工具进行声音提纯。

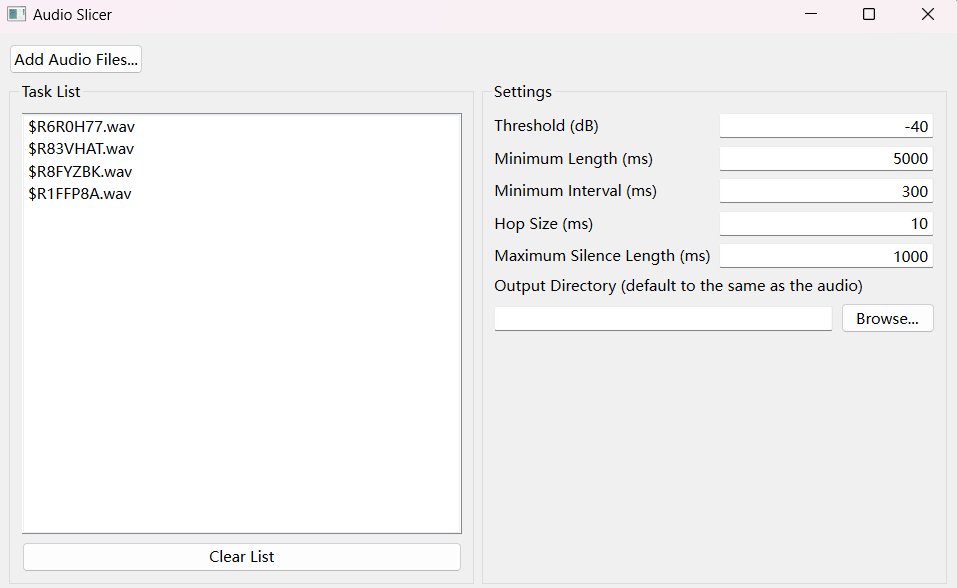

二、对声音素材进行切片

三、对分段音频 进行 文本标注切片好的音频经过手动筛选过短的音频 放入 raw_audio

点击 0.带标点符号的标注

标注完成

打开 bert vist2 整合包 启动 webui

创建 文件夹

启动 webui 创建训练的模型 自己创建目录 将切好片的声音文件 放入 custom_character_voice 将标注好的文本放入 filelists

文本预处理

生成bert 文件

生成 emo文件

写入 训练参数 批大小 根据显卡设置 我这里设置16

训练中

本文结束